Wie man Crawlability-Probleme auf Ihrer Website behebt

Wenn Sie hochwertige Zielkeywords recherchiert und relevante Inhalte erstellt haben, aber nicht in den Suchergebnissen von Google erscheinen, könnte es Probleme mit der Crawlbarkeit geben. Dies sind häufige technische SEO-Probleme, auf die Suchmaschinen-Spiders beim Crawlen der Website stoßen.

Inhaltsverzeichnis

Was sind Crawling-Probleme?

Im Allgemeinen bezieht sich die Crawlability auf die Fähigkeit einer Suchmaschine, die Seiten Ihrer Website zu entdecken und zu durchlaufen. Suchmaschinen verwenden Bots, die als Crawler oder Spider bekannt sind, um Websites zu erkunden, indem sie Links folgen und Inhalte indexieren.

Wenn bestimmte Seiten blockiert sind, werden sie nicht indexiert, sodass sie nicht in den Suchergebnissen erscheinen, und das wird als Crawlability-Problem bezeichnet.

Zu den häufigen Crawlability-Problemen gehören NoFollow-Links, Weiterleitungsschleifen (wenn zwei Seiten einander weiterleiten und unendliche Schleifen erzeugen), eine schlechte Seitenstruktur und eine langsame Website-Geschwindigkeit.

Sagen Sie auf Wiedersehen zu langsamen Websites!

WP Speed of Light wird mit einem leistungsstarken statischen Cache-System geliefert und enthält eine Ressourcengruppe und ein Minification-Tool, ein Datenbankbereinigungssystem, ein .htaccess-Optimierungstool und einen automatischen Cache-Reiniger.

Wie behebt man Crawling-Probleme?

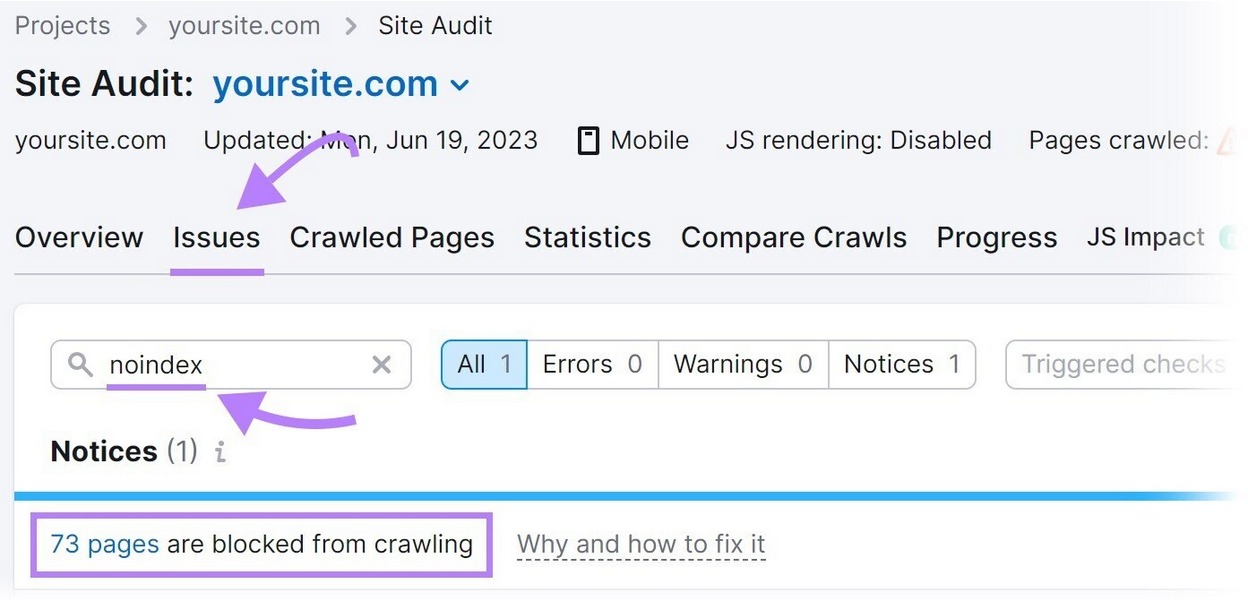

1. Noindex-Tags

Wenn die Suchmaschine Ihre Website für längere Zeit nicht mehr indiziert, kann Google schließlich aufhören, Ihre Seite zu crawlen. In diesem Fall betrachtet Google No‑Index‑Tags als Nofollow‑Tags. Aber keine Sorge, es gibt Lösungen.

Erstens sollten Sie No‑Index‑Tags auf Seiten verwenden, die Sie wirklich nicht indiziert haben möchten, wie Anmeldeseiten, Danke‑Seiten oder doppelte Inhalte. Zweitens sollten Sie Ihre No‑Index‑Tags regelmäßig überprüfen und anschließend Crawling‑Tools einsetzen, um Nicht‑Index‑Probleme zu identifizieren. Dies kann Ihnen helfen, unnötige No‑Index‑Tags zu finden und zu entfernen.

2. Defekte Links (404-Fehler)

Defekte Links können das Crawlen behindern und verhindern, dass Suchmaschinen auf Ihre Inhalte zugreifen. Dies kann zu einer verringerten Sichtbarkeit in den Suchergebnissen führen.

Überprüfen und aktualisieren Sie Ihre Seite regelmäßig, um veraltete URLs zu entfernen oder zu ersetzen. Wenn Sie defekte Links finden, beheben Sie diese sofort, indem Sie den Link aktualisieren oder entfernen. Minimieren Sie unnötige Weiterleitungen und aktualisieren Sie interne Links, um die Struktur Ihrer Website widerzuspiegeln.

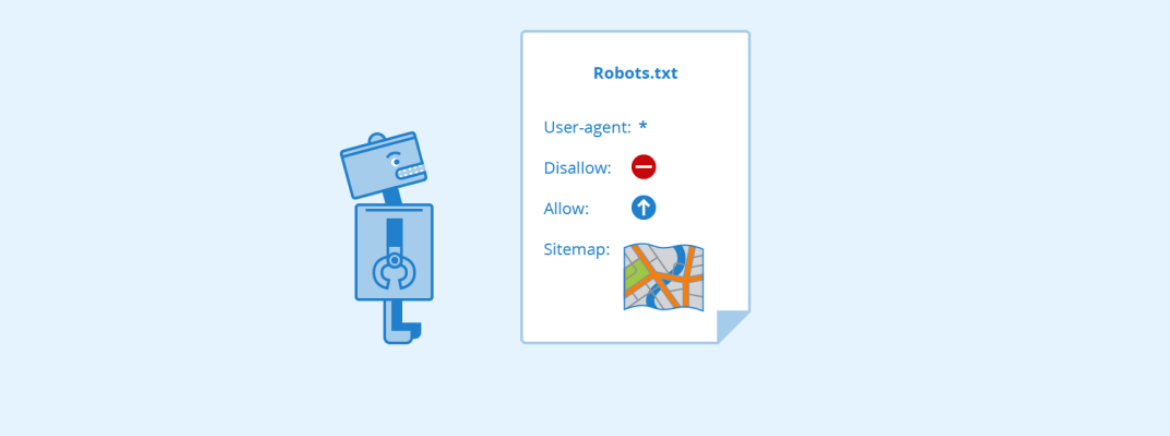

3. Crawlierbarkeitsprobleme im Zusammenhang mit robots.txt

Eines der häufigsten Crawl‑Probleme hängt mit der robots.txt zusammen. Dieses Problem kann die Indexierung Ihrer Inhalte behindern.

Um dieses Problem zu beheben, beginnen Sie damit, die robots.txt‑Datei Ihrer Website's zu prüfen. Stellen Sie sicher, dass wichtige Seiten und Ordner nicht blockiert sind. Verwenden Sie den Robots.txt‑Tester von Google's in der Google Search Console, um Probleme mit Ihrer robots.txt‑Datei zu erkennen und zu testen.

Falls nötig, passen Sie Ihre robot.txt‑Datei an, um Suchmaschinen das Crawlen wichtiger Seiten und Verzeichnisse zu ermöglichen. Behalten Sie die Änderungen Ihrer Website im Auge.

4. Langsame Ladezeit der Seite

Die langsame Ladezeit der Seite frustriert die Suchmaschinen-Crawler und kann Ihre Inhalte nicht effizient indizieren, also stellen Sie sicher, dass Sie das Problem sofort beheben!

Sie können versuchen, die Dateigröße der Bilder zu reduzieren ohne Qualitätseinbußen, um das Laden zu beschleunigen. Verwenden Sie außerdem ein content delivery network (CDN), um Inhalte näher an die Benutzer zu verteilen und die Latenz zu reduzieren.

Darüber hinaus ist die Serveroptimierung der Schlüssel zur Verbesserung der Serverleistung durch Reduzierung der Serverantwortzeiten und die Verwendung von zuverlässigem Hosting.

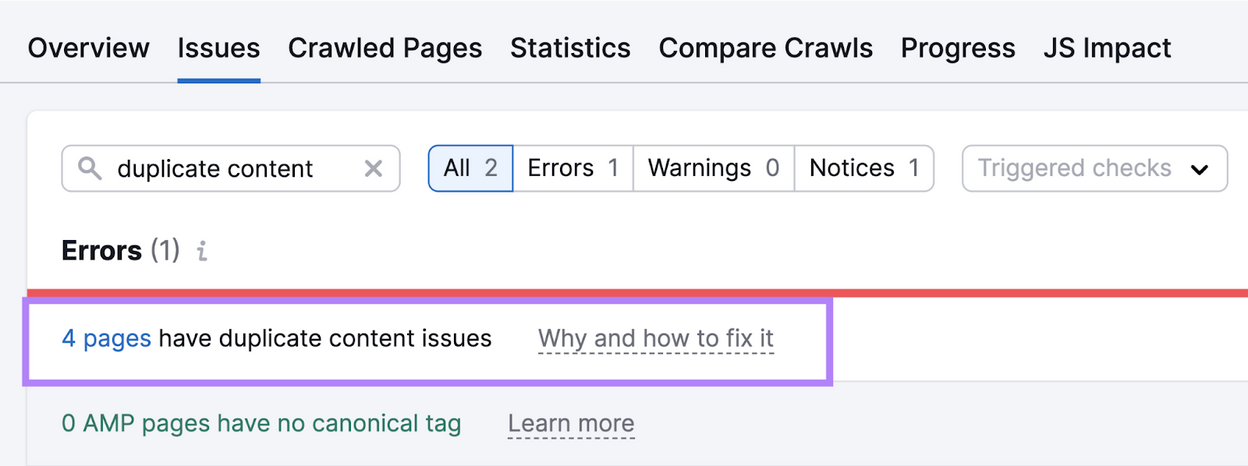

5. Doppelte Inhalte

Wenn Suchmaschinen identische oder ähnliche Inhalte auf mehreren Seiten finden, wissen sie möglicherweise nicht, welche Version indiziert werden soll. Es ist wichtig, dass Ihre Website eine klare und einzigartige Inhaltslandschaft bietet.

Um dies zu beheben, verwenden Sie kanonische Tags, um die primäre Version der Seite anzugeben. Organisieren Sie Ihre URLs logisch und konsistent. Produzieren Sie außerdem regelmäßig einzigartige und hochwertige Inhalte. Führen Sie doppelte Seiten zusammen oder verwenden Sie 301-Weiterleitungen, um sie zu konsolidieren.

6. Zugehörig zu XML-Sitemap-Fehler

Im Allgemeinen leitet eine XML‑Sitemap Suchmaschinen dabei, die Inhalte Ihrer Website zu finden und zu verstehen. Fehler in der Sitemap können zu einer unvollständigen Indexierung und geringerer Sichtbarkeit in den Suchergebnissen führen.

Sie müssen die Sitemap überprüfen, um Fehler oder Inkonsistenzen zu erkennen. Anschließend stellen Sie sicher, dass Ihre XML‑Sitemap die aktuelle Struktur und den Inhalt Ihrer Website widerspiegelt.

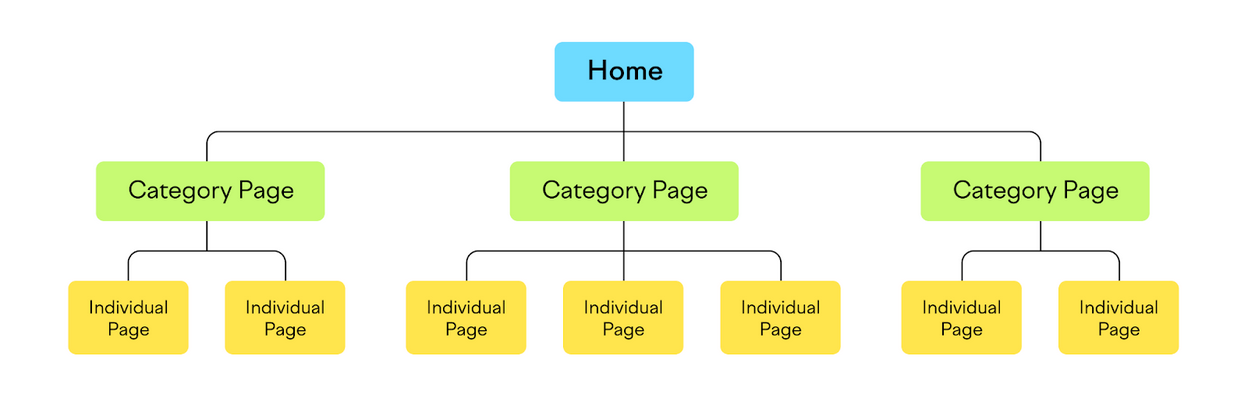

7. Schlechte Website-Architektur

Die Struktur der Website könnte eine Ursache für Crawling-Probleme sein. Daher ist es wichtig, eine schlechte Website-Architektur zu korrigieren, damit die Such-Bots Ihre Inhalte finden und in den Suchergebnissen erscheinen können.

Wenn Sie dieses Problem beheben möchten, sollten Sie eine inkonsistente Hierarchie und Kategorisierung sowie die Verlinkung Ihrer Seiten vermeiden, da dies die Suchmaschinen-Crawler verwirren kann.

Erstellen Sie daher eine klare Hierarchie und organisieren Sie Ihre Inhalte in logische Kategorien und Unterkategorien. Verlinken Sie diese dann auf eine Weise, die diese Hierarchie widerspiegelt.

8. Mobilfreundlichkeit

Die mobile Benutzerfreundlichkeit ist ein wichtiger Schwerpunkt für SEO. Deshalb kann Google die Seite, wenn sie für mobile Geräte als unbrauchbar eingestuft wird, in den Suchergebnissen niedriger einstufen.

Testen Sie Ihre wichtigsten Zielseiten im Google Mobile Friendly Tester-Tool und überwachen Sie die Probleme in der Google Search Console. Außerdem prüfen Sie das Ergebnis und stellen sicher, dass der Inhalt der Seite angezeigt wird.

9. Darstellungsprobleme

Google's Fähigkeit, JavaScript zu rendern, verbessert sich. Obwohl progressive Verbesserung nach wie vor die empfohlene Methode ist, it's nützlich, Seiten vollständig so zu rendern, wie Google es tut, um zu erleben, was ein Suchender auf der Seite finden würde.

Wenn die "gerenderte" Version nicht den wesentlichen Inhalt der Seite enthält, gibt es wahrscheinlich ein Problem, das behoben werden muss. Dies sollte auch mit der zwischengespeicherten Version einer Seite übereinstimmen. Danach analysieren Sie die Ergebnisse eines JS-gerenderten Crawls.

10. Dünne Inhalte

Wenn Ihre Website keines der oben genannten Probleme hat, aber dennoch nicht indiziert ist, könnten Sie "thin content" oder Inhalte mit geringem Wert haben. Um das zu beheben, analysieren Sie die Inhalte der Website, die von Google nicht indiziert wurden. Und überprüfen Sie die Zielabfragen für die Seite. Zusätzlich aktualisieren Sie die Inhalte oder erstellen neue Inhalte basierend auf Keyword-Recherche und Suchintention, um einen besseren Wert zu bieten.

WP Meta SEO gibt Ihnen die Kontrolle über Ihre gesamte SEO-Optimierung. SEO-Masseninhalt und Bild-SEO, Überprüfung des Seiteninhalts, 404 und Weiterleitung.

Schlussfolgerung

So beheben Sie das Crawlability-Problem, indem Sie diese häufigen Probleme identifizieren und lösen. Wenn Sie das tun, können Sie die Leistung Ihrer Website in den Suchergebnissen verbessern, mehr organischen Traffic anziehen und die SEO-Gesundheit erhalten.

Vergessen Sie nicht, regelmäßig zu überwachen, und proaktive Korrekturen halten Ihre Seite sowohl für Suchmaschinen als auch für Nutzer zugänglich.

Wenn Sie unseren Blog abonnieren, senden wir Ihnen eine E-Mail, wenn es neue Updates auf der Seite gibt, damit Sie sie nicht verpassen.

Kommentare