Cách sửa lỗi vấn đề thu thập dữ liệu trên trang web của bạn

Nếu bạn đã nghiên cứu các từ khóa mục tiêu có giá trị cao và tạo nội dung liên quan, nhưng không xuất hiện trong kết quả tìm kiếm của Google, có thể là do các vấn đề về khả năng thu thập dữ liệu. Đây là những vấn đề kỹ thuật SEO phổ biến mà các trình thu thập dữ liệu của công cụ tìm kiếm gặp phải khi thu thập dữ liệu trang web.

Nội dung bảng

Các vấn đề về khả năng thu thập dữ liệu là gì?

Nói chung, khả năng thu thập dữ liệu đề cập đến khả năng của công cụ tìm kiếm trong việc khám phá và điều hướng qua các trang trên website của bạn website. Các công cụ tìm kiếm sử dụng bot, được gọi là trình thu thập hoặc spider, để khám phá websites bằng cách theo dõi các liên kết và lập chỉ mục nội dung.

Nếu một số trang bị chặn, chúng sẽ không được lập chỉ mục, vì vậy chúng sẽ không xuất hiện trong kết quả tìm kiếm, và điều này được gọi là vấn đề khả năng thu thập dữ liệu.

Các vấn đề thường gặp về khả năng thu thập dữ liệu bao gồm liên kết nofollow, vòng lặp chuyển hướng (khi hai trang chuyển hướng lẫn nhau tạo ra vòng lặp vô hạn), cấu trúc site kém, và tốc độ site chậm.

Tạm biệt trang web chậm chạp website!

WP Speed of Light đi kèm với hệ thống bộ nhớ đệm tĩnh mạnh mẽ, bao gồm nhóm tài nguyên và công cụ thu nhỏ, hệ thống dọn dẹp cơ sở dữ liệu, công cụ tối ưu hóa .htaccess và trình dọn dẹp bộ nhớ đệm tự động.

Làm thế nào để khắc phục các vấn đề về khả năng thu thập thông tin?

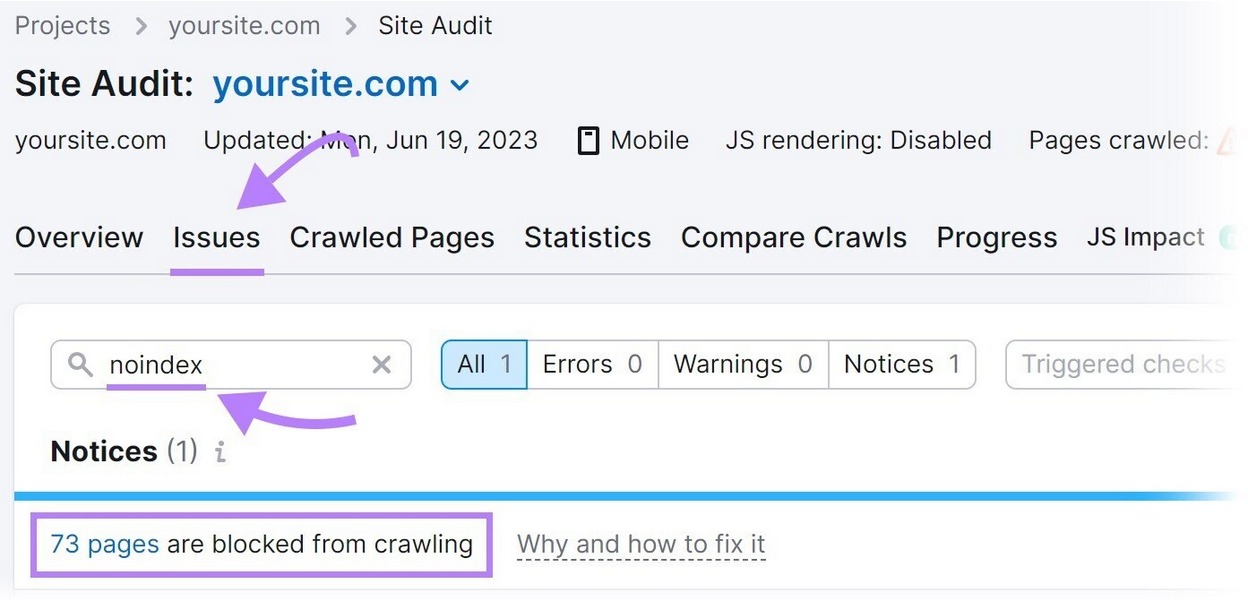

1. Thẻ Noindex

Nếu công cụ tìm kiếm ngừng lập chỉ mục cho website trong một thời gian dài, Google có thể cuối cùng ngừng thu thập dữ liệu trang của bạn. Trong trường hợp này, Google coi thẻ không lập chỉ mục là thẻ không theo dõi. Nhưng đừng lo, có các giải pháp.

Đầu tiên, sử dụng thẻ noindex trên các trang mà bạn thực sự không muốn được lập chỉ mục, như trang đăng nhập, trang cảm ơn, hoặc nội dung trùng lặp. Thứ hai, thường xuyên xem xét các thẻ noindex của bạn, sau đó sử dụng công cụ thu thập để xác định các vấn đề không lập chỉ mục. Điều này có thể giúp bạn tìm và loại bỏ các thẻ noindex không cần thiết.

2. Liên kết bị hỏng (Lỗi 404)

Các liên kết hỏng có thể cản trở quá trình thu thập dữ liệu và ngăn các công cụ tìm kiếm truy cập nội dung của bạn. Điều này có thể dẫn đến giảm khả năng hiển thị trong kết quả tìm kiếm.

Hãy thường xuyên kiểm tra và cập nhật trang web của bạn để loại bỏ hoặc thay thế các URL lỗi thời. Khi bạn phát hiện liên kết hỏng, hãy sửa chúng ngay lập tức bằng cách cập nhật liên kết hoặc xóa bỏ. Giảm thiểu các chuyển hướng không cần thiết và cập nhật các liên kết nội bộ để phản ánh cấu trúc website'cấu trúc.

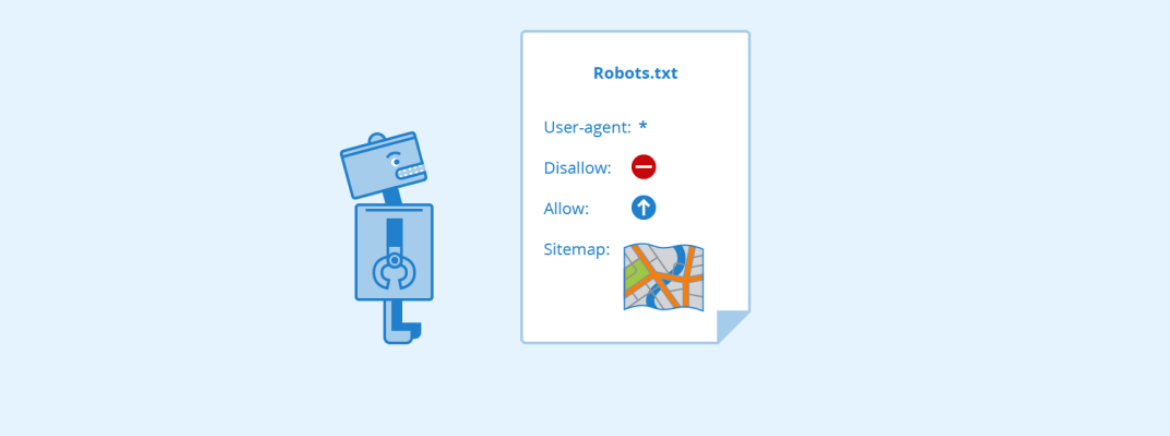

3. Vấn đề Khả năng Thu thập Dữ liệu Liên quan đến robots.txt

Một trong những vấn đề phổ biến nhất về khả năng thu thập dữ liệu liên quan đến Robots.txt. Vấn đề này có thể cản trở việc lập chỉ mục nội dung của bạn.

Để giải quyết vấn đề này, bắt đầu bằng việc kiểm tra website's robots.txt file. Đảm bảo các trang và thư mục quan trọng không bị chặn. Sử dụng công cụ kiểm tra Robots.txt của Google trong Google Search Console để giúp bạn xác định và kiểm tra các vấn đề với tệp robots.txt của mình.

Nếu cần, chỉnh sửa tệp robots.txt của bạn để cho phép các công cụ tìm kiếm thu thập các trang và thư mục quan trọng. Hãy chú ý khi website thay đổi.

4. Tốc độ tải trang chậm

Thời gian tải trang chậm làm cho các trình thu thập thông tin của công cụ tìm kiếm bị bực tức và có thể không lập chỉ mục nội dung của bạn một cách hiệu quả, vì vậy hãy đảm bảo bạn khắc phục nó ngay lập tức!

Bạn có thể thử giảm kích thước tệp hình ảnh mà không ảnh hưởng đến chất lượng để tăng tốc độ tải. Ngoài ra, hãy sử dụng content delivery network (CDN) để phân phối nội dung gần hơn với người dùng và giảm độ trễ.

Hơn nữa, tối ưu hóa máy chủ là chìa khóa để nâng cao hiệu suất của máy chủ bằng cách giảm thời gian phản hồi của máy chủ và sử dụng dịch vụ lưu trữ đáng tin cậy.

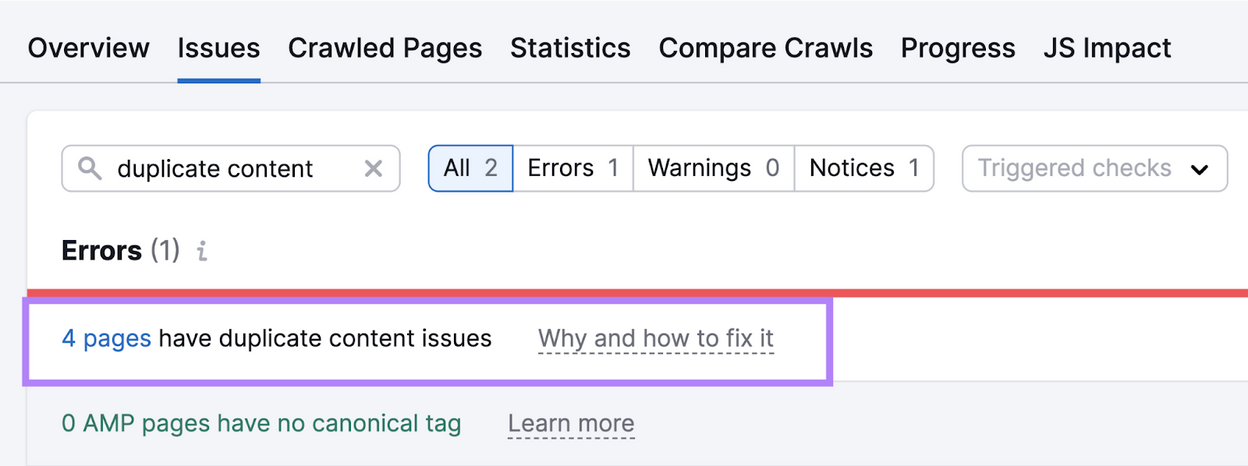

5. Duplicate Content

Khi các công cụ tìm kiếm tìm thấy nội dung giống hoặc tương tự trên nhiều trang, họ có thể không biết phiên bản nào để lập chỉ mục. Đảm bảo website của bạn cung cấp một khung cảnh nội dung rõ ràng và độc đáo là rất quan trọng.

Để khắc phục, hãy sử dụng thẻ canonical để chỉ ra phiên bản chính của trang. Tổ chức ULRs của bạn một cách logic và nhất quán. Ngoài ra, thường xuyên sản xuất nội dung chất lượng cao. Hợp nhất các trang trùng lặp hoặc sử dụng chuyển hướng 301 để củng cố chúng.

6. Liên quan đến Lỗi Sitemap XML

Thông thường, một sơ đồ XML hướng dẫn các công cụ tìm kiếm trong việc định vị và hiểu nội dung của bạn website's nội dung. Lỗi trong sơ đồ có thể dẫn đến việc lập chỉ mục không đầy đủ và giảm khả năng hiển thị trong kết quả tìm kiếm.

Bạn cần xem xét để phát hiện lỗi hoặc không nhất quán. Sau đó, đảm bảo sơ đồ XML của bạn phản ánh hiện tại website cấu trúc và nội dung.

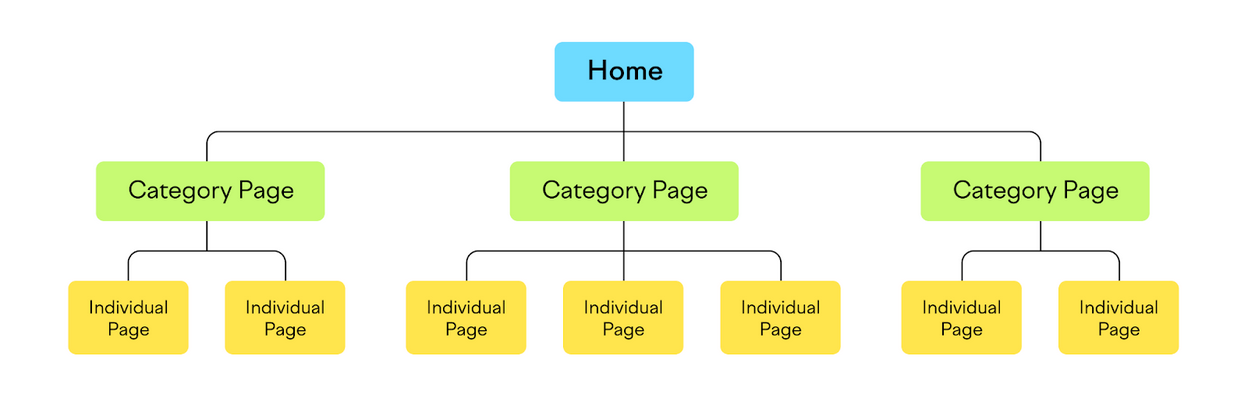

7. Kiến trúc Website kém

Cấu trúc websitecấu trúc có thể là một nguyên nhân gây ra các vấn đề về khả năng thu thập dữ liệu. Do đó, việc sửa chữa kém website cấu trúc có thể là một nguyên nhân gây ra các vấn đề về khả năng thu thập dữ liệu. Do đó, việc sửa chữa kém websitecấu trúc có thể là một nguyên nhân gây ra các vấn đề về khả năng thu thập dữ liệu. Do đó, việc sửa chữa kém website cấu trúc có thể là một nguyên nhân gây ra các vấn đề về khả năng thu thập dữ liệu. Do đó, việc sửa chữa kém website kiến trúc là rất quan trọng, để các bot tìm kiếm có thể tìm thấy nội dung của bạn và xuất hiện trong kết quả tìm kiếm.

Nếu bạn muốn khắc phục vấn đề này, hãy chắc chắn tránh việc sắp xếp không nhất quán và phân loại cũng như liên kết các trang của bạn có thể gây nhầm lẫn cho các trình thu thập dữ liệu của công cụ tìm kiếm.

Vì vậy, hãy tạo một cấu trúc phân cấp rõ ràng và sắp xếp nội dung của bạn thành các danh mục và tiểu mục logic. Sau đó, liên kết chúng lại với nhau theo cách phản ánh cấu trúc phân cấp đó.

8. Khả năng Sử dụng trên Di động

Tính khả dụng trên di động đã trở thành ưu tiên quan trọng cho SEO. Đó là lý do, nếu trang web được coi là không thể sử dụng trên thiết bị di động, Google có thể xếp hạng chúng thấp hơn trong kết quả tìm kiếm.

Kiểm tra các trang đích quan trọng của bạn bằng công cụ Google Mobile Friendly Tester và giám sát các vấn đề trong Google Search Console. Hơn nữa, xem lại kết quả và đảm bảo nội dung của trang web xuất hiện.

9. Sự cố kết xuất

Khả năng của Google's trong việc render JavaScript đang được cải thiện. Mặc dù progressive enhancement vẫn là phương pháp được khuyến nghị, nhưng việc render đầy đủ các trang như Google làm giúp trải nghiệm những gì người tìm kiếm sẽ thấy trên trang.

Nếu phiên bản "rendered" không chứa nội dung quan trọng trên trang, thì có khả năng có vấn đề cần giải quyết. Điều này cũng nên khớp với phiên bản được lưu trong bộ nhớ cache của một trang. Sau đó, phân tích kết quả của quá trình thu thập dữ liệu được render bằng JS.

10. Nội dung mỏng

Nếu trang web của bạn không gặp bất kỳ vấn đề nào ở trên nhưng vẫn chưa được lập chỉ mục, bạn có thể có "nội dung mỏng" hoặc nội dung có giá trị thấp. Để khắc phục, hãy phân tích nội dung của trang web chưa được Google lập chỉ mục. Và xem xét các truy vấn mục tiêu cho trang. Ngoài ra, làm mới nội dung hoặc tạo nội dung mới dựa trên nghiên cứu từ khóa và ý định tìm kiếm để cung cấp giá trị tốt hơn.

WP Meta SEO cung cấp cho bạn quyền kiểm soát tất cả tối ưu hóa SEO của bạn. Nội dung SEO hàng loạt và SEO hình ảnh, kiểm tra nội dung trên trang, 404 và chuyển hướng.

Kết luận

Đó là cách khắc phục vấn đề crawlability, bằng cách xác định và giải quyết các vấn đề chung này. Nếu bạn làm như vậy, bạn có thể cải thiện website's hiệu suất trong kết quả tìm kiếm, thu hút nhiều lưu lượng truy cập tự nhiên hơn, và duy trì sức khỏe SEO.

Đừng quên thường xuyên giám sát và các biện pháp khắc phục chủ động sẽ giữ cho trang web của bạn luôn khả dụng cho cả công cụ tìm kiếm và người dùng.

Khi bạn đăng ký theo dõi blog, chúng tôi sẽ gửi cho bạn một email khi có bản cập nhật mới trên trang web để bạn không bỏ lỡ chúng.

Bình luận